Periodista por un día > Mirando al Mundo desde las Redes Neuronales

Publicado el 5 de abril de 2021

Mirando al Mundo desde las Redes Neuronales

Las redes neuronales son artefactos ingeniosos de la IA, usados para resolver problemas complejos. Pero la comunidad reciente el hecho de que sus resultados parecen mágicos y el mecanismo parece una astuta caja negra. Un trabajo alemán propone una sencilla estrategia para mirar dentro de las redes neuronales y saber qué están pensando

En nuestros días las Redes Neuronales se han convertido en poderosas aliadas para resolver muchos tipos de problemas. Un subtipo especialmente moderno es el de las Redes Neuronales Convolucionales, gracias a las cuales los médicos pueden hallar por ejemplo tumores.

Sin embargo, la complejidad que tienen se convierte en una sombra negra que previene a varios de su uso. Esto hace que esta poderosísima herramienta de la IA muchas veces sea considerada un complemento de otras técnicas más tradicionales y que su uso sea limitado.

El alemán Jörg Wagner del Centro Bosch para la Inteligencia Artificial, y su grupo han propuesto una manera que no resuelve el problema en su totalidad pero ayuda en muchos casos donde las Redes Neuronales Convolucionales se usan para extraer información de imágenes.

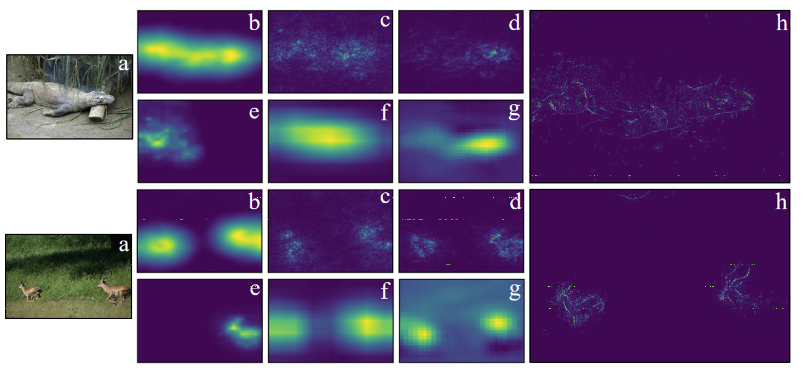

Su propuesta es simple y efectiva: espiar dentro de la red lo que sucede, colocando una especie de lupa en el lugar adecuado de la red y no dejar que la lupa se ensucie.

Si bien hay otros métodos conocidos en el sector que sirven para colocar la lupa, la misma a veces se empaña y se ve borroso, o no tiene suficiente potencia y se pierden partes, o se ensucia con los residuos que genera el engranaje de la red neuronal convolucional durante su trabajo.

La comparación de la imagen original (a) con otros métodos (b, c, d, e, f, g) y la propuesta de Wagner (h). En el último caso se logran detectar los componentes esenciales sin perder partes ni borronearlas.

En resumen, si bien las Redes Neuronales son una poderosa herramienta de la IA, existen muchos problemas para explicar sus resultados. En el caso de las imágenes ya existe la propuesta de Wagner para ver parte del razonamiento y comprender mejor cómo llega a sus conclusiones.

Artículo original: Jorg Wagner, Jan Mathias Kohler, Tobias Gindele, Leon Hetzel, Jakob Thaddaus Wiedemer, Sven Behnke; The IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2019, pp. 9097-9107. The final, published version of this paper is available on IEEE Xplore. https://openaccess.thecvf.com/content_CVPR_2019/html/Wagner_Interpretable_and_Fine-Grained_Visual_Explanations_for_Convolutional_Neural_Networks_CVPR_2019_paper.html

Daniela López De Luise

Academia Nacional de Ciencias de Buenos Aires

Académica coordinadora CETI

E-mail: daniela_ldl@ieee.org